阿里 Qwen2.5-Coder-32B PK Claud Sonnet

Cursor 编程实测:Qwen2.5-Coder-32B vs Claud-3.5-Sonnet

2024-11-14

ollamaqwen2.5qwenclaud

先说重点:

- 能力强:接近闭源一线大模型。

- 数据安全友好:对于不能使用联网 AI 编程工具的用户,是即便宜性能又好的选择。

- 实战测试:文末会将 Cursor 的默认模型换成 Qwen2.5-Coder-32B,写一个 Nuxt 落地页,并与 Sonnet 对比。

一、能力强

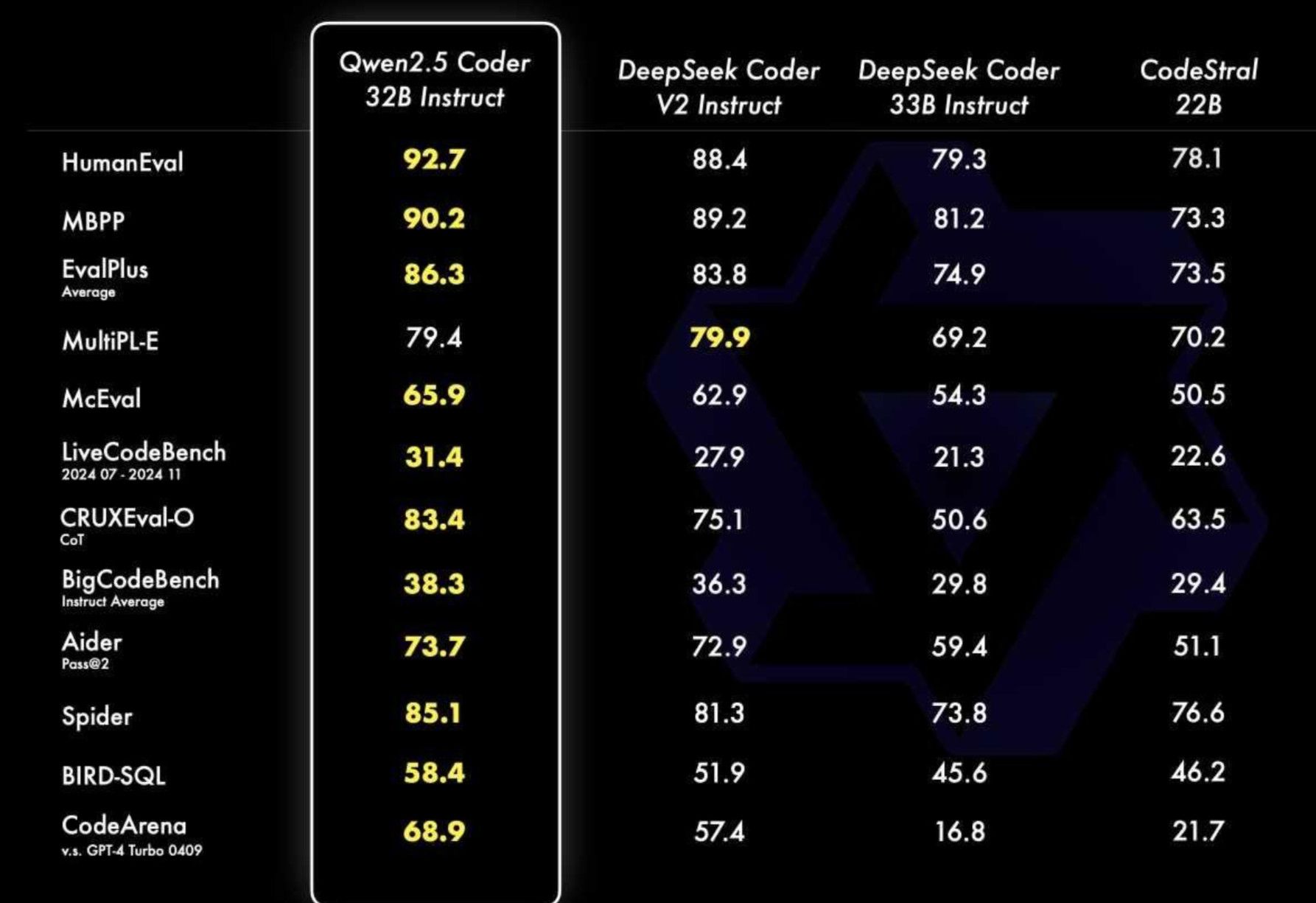

先引用下官方的数据,确实很能打。但是官方的数据可能让人不那么信服,跑分谁不会呢。

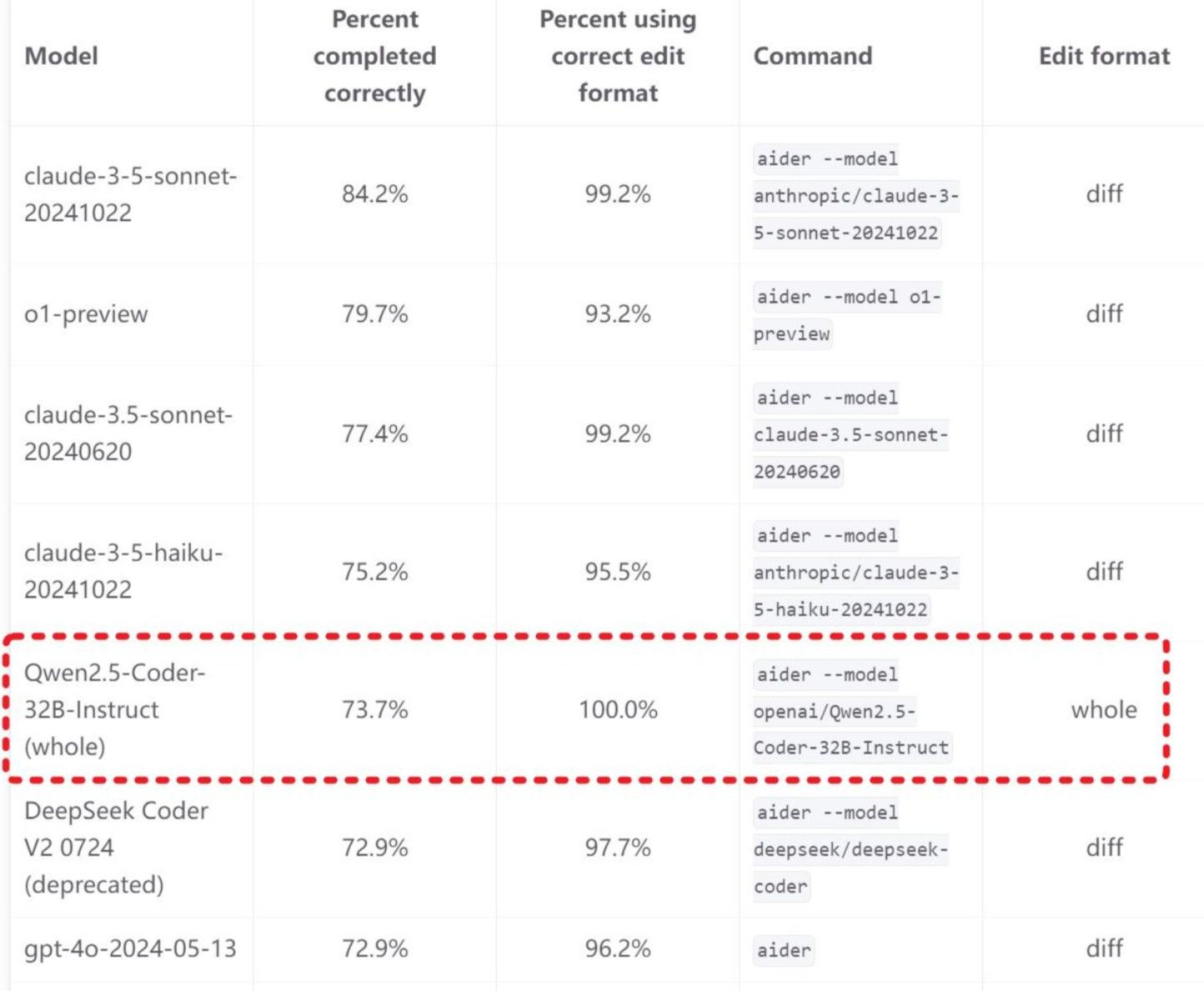

那就看看其他独立测试的数据吧。这里引用 Paul Gauthier 的 Aider 基准测试 来看看具体成绩:

测评描述:

新的 Qwen 2.5 Coder 型号在 Aider 的代码编辑基准测试中表现非常出色。32B Instruct 模型的得分在 GPT-4o 和 3.5 Haiku 之间。

Qwen2.5-Coder-32B 与 GPT-4o 持平(但略落后于 Claude 3.5 Haiku)。

二、安全

为什么企业对上传数据的 AI 编程助手特别敏感?

- 代码资产安全

- 公司核心代码可能包含商业机密。

- 上传到第三方服务器存在泄露风险。

- 代码可能被用于训练其他模型的担忧。

- 合规要求

- 金融、医疗等行业有严格的数据管制。

- 某些项目需要完全的离线环境。

- 跨境数据传输的合规问题。

Qwen2.5-Coder 的优势

- 离线部署:代码永远不会离开本地环境。

- 安全性高:无需担心网络安全问题。

- 支持私有化部署:可运行在内网。

三、实战测试:开发一个 Nuxt 落地页

使用最近特别火的 Cursor,让 Qwen2.5-Coder-32B PK CLAUDE-3.5-SONNET。

测试方法:

- 使用 Ollama 本地部署 Qwen2.5-Coder-32B。

- 分别使用 Cursor 默认模型和 Qwen2.5,写一个基于 Nuxt.js 的落地页(使用 Tailwind CSS)。

步骤:

- 启动 Ollama

(安装下载模型步骤省略,模型下载前面飞快,最后有亿点点慢。)ollama run qwen2.5-coder:32b好家伙,4090 显存快吃光了!

- 初始化 Nuxt 以及 TailwindCSS

npx nuxi@latest init qwen25 cd qwen25 npx nuxi@latest module add tailwindcss code . - 测试正式开始

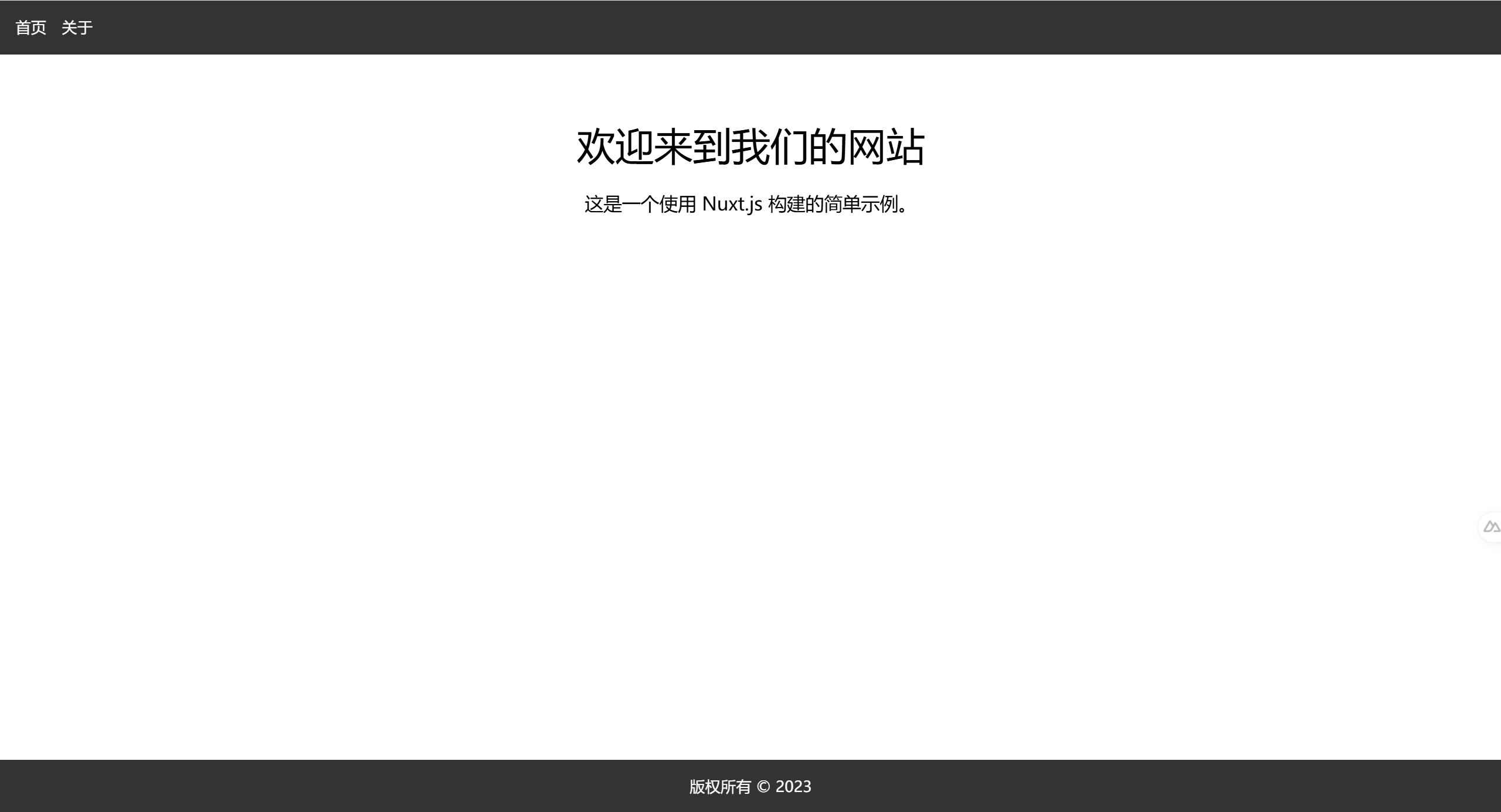

第一轮测试

Prompt:

- 删除所有默认的欢迎组件和示例代码。

- 设置基础 layout,需要包含:

- 响应式导航栏。

- 页脚。

- 主内容区域。

结果:

- Qwen2.5:删除欢迎组件和示例代码成功,但未正确修改 layout 文件,在追问后完成。

- CLAUDE-3-5-SONNET:一次性完成,审美较强。

界面比较:

- Qwen2.5

- CLAUDE-3-5-SONNET

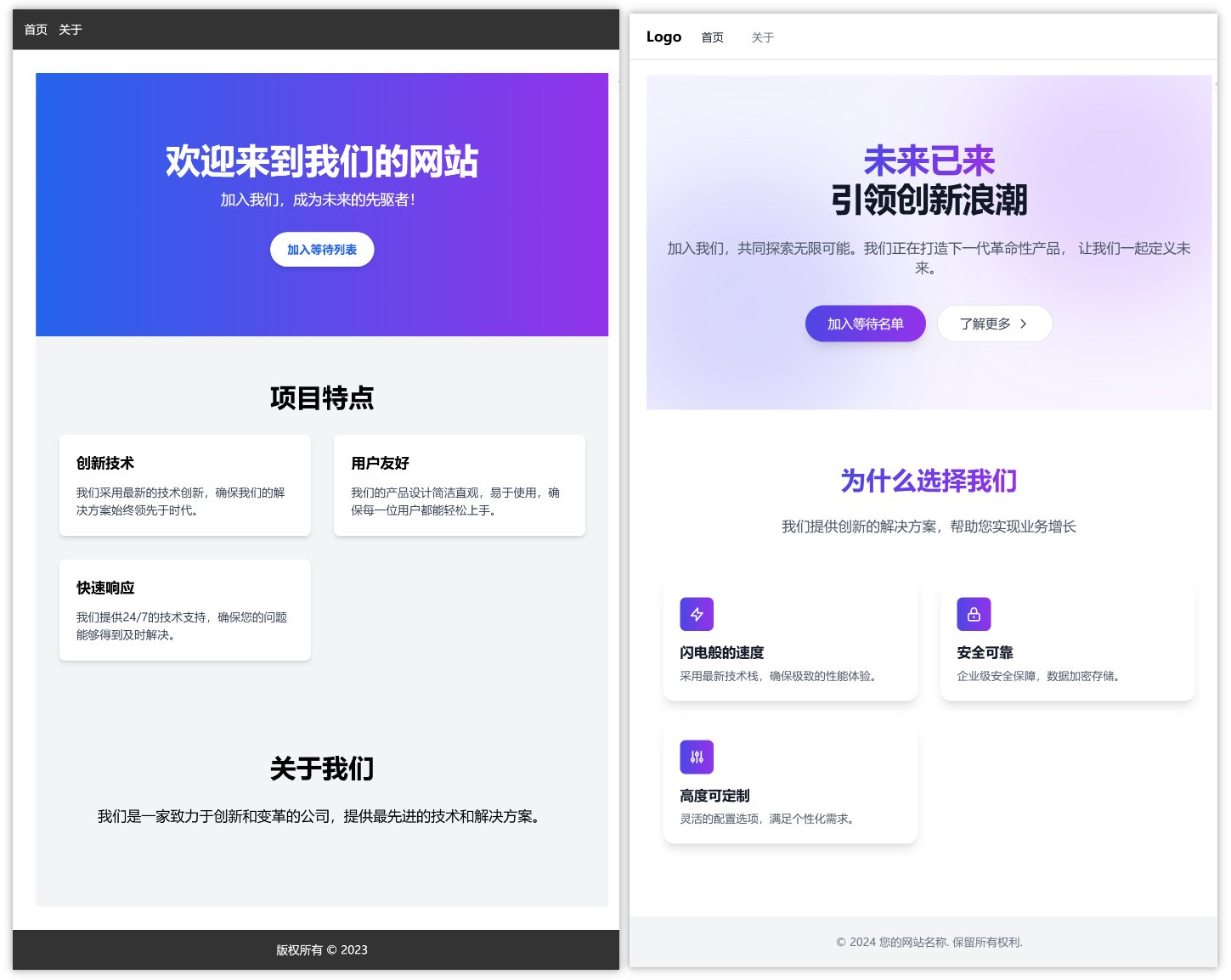

第二轮测试

Prompt: 请继续修改优化这个 Landing Page,需要包含以下部分:

- 一个引人注目的 hero section,包含标题、简短描述和 waiting list 按钮。

- 风格需为活力动感。

具体要求:

- 使用 Nuxt 3 的最新特性。

- 遵循移动优先的响应式设计。

- 使用 Tailwind CSS 进行样式设计。

结果:

- Qwen2.5:基本完成所有指令。

- CLAUDE-3-5-SONNET:表现明显更胜一筹,审美与实现更优。

五、总结

优势:

- 离线部署保障安全。

- 性能接近一线最强商业模型。

- 部署门槛较低(民用卡单张可跑)。

不足:

- 硬件有一定要求(很多平台已经陆续提供,价格也很美丽)。

- 需要适当追问才能获得最佳结果,与 Claude-Sonnet 存在差距。